Proxmox Tipps und Tricks V1.15 (c) Stor IT Back 2026

Proxmox von Hardware über Installation bis zum sicheren Betrieb

Proxmox, was ist das eigentlich?

Proxmox ist ein österreichischer Softwarehersteller der Open-Source-Plattformen für Virtualisierung, Backup und ein Mail Gateway entwickelt. Die

Software ist quelloffen und lässt sich ohne Funktionseinschränkungen komplett kostenfrei nutzen. Proxmox bietet Support und Service für seine

Produkte an, man zahlt also nicht für die Lizenzen, sondern für den Support. Dies ist in produktiven Umgebungen sehr wichtig, aber die Software lässt

sich im vollen Funktionsumfang vorab testen bzw. uneingeschränkt betreiben.

Wir beschäftigen uns auf dieser Seite speziell mit Proxmox VE (der Virtualisierung) und dem Backup-Server.

Inhaltsverzeichnis Proxmox Tipps & Tricks

- 1. Allgemeines zu Proxmox VE

- 2. Installation von Proxmox VE

- 3. Proxmox VE und Storage

- 4. Proxmox VE und Netzwerke

- 5. Virtuelle Maschine / Linux Container

- 6. Datensicherung

- 7. Sicherheit / Überwachnung

- 8. Troubleshooting

Ziel-Gruppe für Proxmox

Proxmox VE lässt sich sehr flexibel einsetzen und kann an die benötigte Umgebung angepasst werden. Also ein Produkt für viele Umgebungen.

Als Beispiel können drei sehr unterschiedliche Gruppen betrachtet werden:

1. Ein kleines Unternehmen, was nur ein zwei oder drei Anwendungen virtualisieren möchte, wenig Budget zur Verfügung hat, aber trotzdem viel Leistung und Verfügbarkeit benötigt:

a) Single Server mit Proxmox und ZFS (Hardware dann mit 7x24x4 Support)

b) Replikationen auf einen zweiten Server mit ZFS / Proxmox Backup Server

c) Unkompliziert, geringe Kosten, hohe Leistung

d) jederzeit erweiterbar auf Cluster oder Ceph

2. Der Mittelstand mit mindestens drei Proxmox VE Server, aber keinen externen Shared Storage, sondern Ceph:

a) Drei identische Server mit redundantem Netzwerk und internen SSDs als Speicherplatz

b) Live Migration, High Availability und Datensicherung auf Proxmox Backup Server

c) extrem flexibel, hoch verfügbar, auch der zweite Standort / Brandabschnitt ist kein Problem

3. Größeres Unternehmen mit vielen VMs, hoher Performance und mehreren Standorten oder Filialen:

a) die passende Anzahl von Proxmox VE Server

b) einen eigenen Ceph Cluster mit 3 oder mehr Nodes oder ein externes Shared Storage über iSCSI oder Fibre Channel

c) Proxmox VE Server mit FZS und Replikation in kleinen Filialen

d) Proxmox VE Cluster mit internem Ceph in größeren Filialen mit Replikation in den Hauptstandort

e) Datensicherung auf den Proxmox Backup-Server mit Replikation auf zweiten Standort und/oder Sicherung auf Tape.

f) mehr Virtualisierungs-Nodes - kein Problem

g) mehr Speicherplatz - kein Problem - weitere HDD/SSD im Ceph Node

h) mehr Performance im Speichernetz - kein Problem - weitere Ceph Nodes dazu fügen

Proxmox VE und die passende Hardware

Was ist bei der Hardware-Auswahl zu beachten? Proxmox basiert auf der aktuellen Linux Debian Version, dafür sollte also die Hardware kompatibel sein.

Wichtig wenn ZFS eingesetzt werden soll:

1. ZFS ist KEIN Shared Storage im Cluster!

2. ZFS benötigt physikalische Festplatten oder SSDs, keinen RAID Controller bzw. keine LUN eines RAID Controllers.

3. ZFS benötigt RAM, dies sollte eingeplant werden.

4. Für hohe Performance sollten SSDs (und auch nur SSD oder NVMe) verbaut werden.

5. Für einen Cluster werden mindestens 3 Server benötigt.

6. Im Unternehmen im kritischen Bereich sollten die Server identisch sein.

Wichtig wenn Ceph eingesetzt werden soll:

1. Ceph ist ein Shared Storage.

2. Ceph benötigt mindestens 3 Nodes (es können die Proxmox VE Nodes sein).

3. Ceph benötigt physikalische Festplatten oder SSDs, wie ZFS auch keine LUN eines RAID Controllers.

4. Ceph benötigt RAM und auch CPU Leistung.

5. Ceph benötigt mindestens 10 Gbit/s Ethernet als Netzwerk.

6. Für hohen Durchsatz und beste Performance sollten zwei Netzwerke vorhanden sein.

7. Redundanz ist auch hier besonders wichtig (Netzwerk).

8. Meist werden die Daten auf 3 Nodes "gespiegelt", es muss also genügend Plattenplatz vorhanden sein (3 fach).

9. Ceph kann auf einem eigenen Cluster betrieben werden, also unabhängig von Proxmox.

Proxmox VE Installation Einzelserver

1. Auf Redundanz bzw. die passende Sicherung achten.

2. ZFS ist in diesem Fall das Storage der Wahl, es bietet die meisten Möglichkeiten.

3. Wichtig: Fällt dieser Server aus, so fallen alle VMs und Container auch aus!

4. Backup-Server einrichten und die Backups testen (ZFS bietet viele Möglichkeiten)

Proxmox VE - Storage im Single Server

Proxmox VE bootet vom Fibre Channel SAN

1. Boot-Einstellung in FC HBA

2. Installation auf die LUN, aber kein RAID und kein ZFS

3. Nach dem ersten Boot:

3.a) Die Repositories entsprechend einstellen (über die GUI)

3.b) apt update

3.c) apt install multipath-tools

4. multipath -v3 und die WWID suchen

5. multipath -a WWID

6. apt install multipath-tools-boot

7. reboot

8. Kontrolle, ob das Multipathing erfolgreich war mit multipath bzw. multipath -ll

Hinweis:

Das apt install multipath-tools-boot folgt erst nach dem multipath -a WWID, damit wird die Freigabe der WWID gleich mit in den Bootloader

gebracht. Ist die Freigabe dort nicht vorhanden, dann wird das multipath beim Booten nicht aktiv und nach dem Boot kann es nicht

mehr aktiv werden, da die Devices in Benutzung sind.

Proxmox VE - Boot aus dem FC SAN

Warum sollte ein PVE aus dem FC SAN booten? Wenn der Server keine geeigneten Boot-Platten besitzt und eine Aufrüstung teuer oder

komplex ist. Typischerweise sind dies ESXi Server, die auf Proxmox VE umgezogen werden sollen. Die ESXi Server haben nur SD-Karten für

den Boot und das reicht nicht für Proxmox.

Aber könnte man auch bei einem Neukauf auf die Idee kommen? Könnte es eventuell sogar einen Vorteil haben? Ja, einen klaren Vorteil haben wir, immer

dann, wenn das Storage auch Snapshots erstellen kann. Einfach einen Snapshot vor größeren Änderungen und Updates am System setzen. Gehen die Änderungen

schief, so muss nur der Snapshot zurückgesetzt werden. Ein klarer Vorteil für die Verfügbarkeit, gerade für alle, die nicht so viel Erfahrung mit Linux

haben.

Proxmox VE Installation Cluster und HA

1. Redundanz beachten, mindestens 3 Server (zur Not 2 und ein Quorum)

2. Redundanz im Netzwerk herstellen, Cluster redundant verbinden.

3. Auch für Ceph wird eine redundantes Netzwerk benötigt.

4, Uhrzeit im Cluster MUSS gleich sein, NTP verwenden!

5. ZFS im Cluster ist kein Shared Storage!

6. Ohne Shared Storage ist kein "richtiges" HA möglich.

7. Ceph ist eine sehr gute Alternative für Shared Storage ohne große Nachteile.

Proxmox VE - Cluster erstellen

Proxmox VE - Cluster mit ZFS

Proxmox Cluster und HA - Funktion, Vorteile und Nachteile

Vorteile des Clusters:

1. Zentrale Administration

2. einfache Replikation auf ZFS

3. neuer Cluster in laufenden Systemen nur schwierig

4. Basis für HA

Nachteile des Clusters:

1. Ein (Konfigurations-)Fehler kann sich auf alle Cluster Member auswirken

2. Mehrheit im Cluster verloren, dann können z.B. keine VMs gestartet werden (Tipp: pvecm expected 1)

3. geringer Ressourcen-Mehrverbrauch

Proxmox VE - Cluster und HA, Funktionen, Vor- und Nachteile

Die Bedeutung des Timeservers beim Proxmox Cluster und Ceph

Wichtig ist die richtige Uhrzeit auf den einzelnen Proxmox Nodes. Besonders problematisch wird eine unterschiedliche Zeit in einem Cluster. Warum ist das so?

Viele Schlüssel für die Anmeldung sind zeitabhängig. Ist der Unterschied in den Zeiten zu groß, dann klappen Anmeldungen nicht mehr und auch Verschlüsselungen

können Probleme bekommen.

Neben den reinen Cluster-Funktionen kann der Host aber auch den virtuellen Maschinen die Uhrzeit vorgeben. Und dann sind ganze Umgebungen mit der falschen Uhrzeit

unterwegs ...

Proxmox nutzt normalerweise aus der Grundinstallation heraus Timeserver aus dem Debian Pool. Ist ein interner Zeitserver verfügbar, dann kann auch dieser genutzt werden. Wichtig

ist diese Einstellung, wenn Zeitserver im Internet durch die Firewall geblockt werden.

Unter /etc/chrony/chrony.conf die folgenden Zeilen ergänzen bzw. ersetzen:

server ntp1.example.com iburst

server ntp2.example.com iburst

server ntp3.example.com iburst

Hierbei natürlich die entsprechenden Timeserver als FQN oder IP eintragen. Danach muss der chrony-Dienst noch neu gestartet werden:

systemctl restart chronyd

Kontrolle ob das geklappt hat und der Timeserver auch erreichbar ist:

journalctl --since -1h -u chrony

Hinweis: Diese Einstellung ist aktuell nicht über die GUI erreichbar.

Ceph Storage im Proxmox Cluster

Mit Ceph kann Proxmox einen echten Shared Storage nutzen. Ceph ist hierbei ein verteilter Objektspeicher und kann für virtuelle Maschinen oder Container genutzt werden.

Dies ist sehr ähnlich dem VMware vSAN, da die Ceph Knoten auch auf den Hypervisoren laufen können. Ceph kann jedoch auch als eigenständiger Speicher aufgebaut werden.

Dies sind die Hauptbestandteile eines Ceph Clusters:

- Monitor: Die Monitore überwachen den aktuellen Zustand des Ceph Clusters und kennen alle beteiligten Komponenten. Sie tauschen die Statusinformationen aus. Es wird mindestens ein Monitor benötigt, für die Verfügbarkeit sollten es aber mindestens 2 sein.

- Manager: Seit Version 12 wird auch ein Manager benötigt, der externe Zugriffe regelt und zusätzliche Monitoring-Aufgaben übernimmt.

- OSD (Object Storage Daemon): Dieser Prozess ist für die Speicherung der Daten auf jedem Host zuständig. Es gibt also mindestens einen OSD pro Node des Storage-Clusters und maximal so viele wie HDDs oder SSDs vorhanden sind.

- Journal: Das Journal nimmt alle geschriebenen Daten als erstes auf und wird für evtl. Recovery Funktionen benötigt. Das Journal ist seit Version 12 in den Datenspeicher integriert. Vorher benötigte man ein eigenes Device.

- RBD oder RADOS Block Device: Die ist eine virtuelle Festplatte aus dem Ceph und wird als Device im Proxmox VE genutzt. Es ist im Ceph die Schicht zur Datenspeicherung.

- CephFS: Ein verteiltes Dateisystem mit Cluster-Funktionen. Es kann also auf mehreren Hosts gemountet werden. Das CephFS nutzt MDS, einen Metadaten-Speicher.

- Pool: Dies ist eine logische Einheit, in welchem verschiedene RBD Device zusammengefasst werden bzw. sie werden aus dem Pool gebildet. Im Pool wird festgelegt, wie oft die Daten gespeichert werden sollen, also wie oft repliziert werden muss.

Ceph Storage im Proxmox Cluster erstellen

Proxmox VE 9.0 mit OpenFabric für Ceph Mesh Netzwerk

Mit der 9er Version stellt Proxmox im SDN die Funktion für OpenFabric vor. Damit kann ein Mesh Netzwerk für den Ceph Cluster direkt in der GUI erstellt werden. Dies erleichtert die Einrichtung eines 3-Node Ceph Clusters mit einem Mesh Netzwerk extrem. Es ist alles über die GUI möglich, inklusive der Grundeinrichtung des Ceph. Dies musste bis zur 8er Version noch über die CLI und einige Konfigurationsdateien durchgeführt werden.

Ceph Storage mit Mesh Netzwerk erstellen

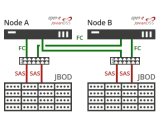

Fibre Channel Shared Storage im Proxmox Cluster

Ein Shared Storage von einem Fibre Channel System (oder auch iSCSI) kann relativ einfach in Proxmox eingebunden werden. Dies ist aber

nicht über die GUI möglich und es sind auch nicht alle benötigten Komponenten vorab installiert. Die Grundkonfiguration muss über SSH

erfolgen, hier müssen die erforderlichen Pakete installiert und konfiguriert werden. Dies sind nur wenige Befehle, die mehr oder weniger

nach einer Anleitung durchgeführt werden können. Wichtig ist allerdings die Kontrolle, ob alles so geklappt hat, wie gefordert.

1. Installation der fehlenden Pakete (auf jedem Knoten):

apt update

apt install multipath-tools

2. Multipathing Grundkonfiguration (auf jedem Knoten):

multipath -v3 (Auslesen der benötigten WWID)

multipath -a WWID (Freigeben der WWID)

multipath -v3 (Aktivieren der WWID)

3.a) LVM einrichten (nur auf einem Knoten):

pvcreate /dev/dm-1

vgcreate san1 /dev/dm-1

3.b) LVM auf den anderen Knoten:

pvscan --cache

pvdisplay (als Kontrolle ob LVM online)

4. Weiter in der GUI

Fibre Channel Shared Storage im Proxmox Cluster

Update: Proxmox VE 9 Fibre Channel Shared Storage mit Snapshot

Eine Neuerung in der PVE 9 sind Snapshots im LVM. Dies wird durch "Volume Chains" erreicht, wobei das Snapshot Volume nur die

Änderungen zum übergeordneten Volume bekommt. Da der LVM (thick) die einzige offizielle Möglichkeit für ein Shared Storage über

FC oder iSCSi ist, gehören jetzt die Nachteile des fehlenden Snapshots der Vergangenheit an.

Es spricht also nichts gegen den Einsatz von herkömmlichen Fibre Channel oder iSCSI Storages in Verbindung mit Proxmox.

Update Fibre Channel Shared Storage mit Snapshot

Auch hier noch die Befehle aus der CLI für Copy&Paste:

1. apt install lsscsi

2. apt install sg3-utils

3. rescan-scsi-bus.sh --forcerescan

4. lsscsi

5. apt install multipath-tools

6. multipath -v3 --> WWID notieren

7. multipath -a WWID

8. multipath -ll

iSCSI Shared Storage im Proxmox Server

Ein iSCSI Storage kann über die GUI in Proxmox eingebunden werden. Aber nur, wenn es nicht redundant angeschlossen ist, also nur mit einem Pfad.

Bei redundanten Anbindungen ist es nicht über die GUI möglich und es sind auch nicht alle benötigten Komponenten vorab installiert. Die Grundkonfiguration muss über SSH

erfolgen, hier müssen die erforderlichen Pakete installiert und konfiguriert werden. Dies sind nur wenige Befehle, die mehr oder weniger

nach einer Anleitung durchgeführt werden können. Wichtig ist allerdings die Kontrolle, ob alle Pfade vorhanden sind und der LVM auch auf dem

multipath Device eingerichtet wurde.

1. Installation der fehlenden Pakete:

apt update

apt install multipath-tools

2. iSCSI Grundkonfiguration:

in /etc/iscsi/iscsid.conf die Zeilen

node.startup = automatic

node.session.timeo.replacement_timeout = 15

ändern. Es dürfen vorher keine Targets verbunden worden sein!

systemctl restart open-iscsi

iscsiadm -m session

lsscsi

Konfiguration der Targets im Proxmox: /etc/iscsi/nodes/*

3. Multipathing Grundkonfiguration (auf jedem Knoten):

multipath -v3 (Auslesen der benötigten WWID)

multipath -a WWID (Freigeben der WWID)

multipath -v3 (Aktivieren der WWID)

4.a) LVM einrichten (nur auf einem Knoten):

pvcreate /dev/dm-1

vgcreate iscsi1 /dev/dm-1

4.b) LVM auf den anderen Knoten:

pvscan --cache

pvdisplay (als Kontrolle ob LVM online)

5. Weiter in der GUI

iSCSI Shared Storage im Proxmox Server

ZFS Performance Tuning mit Schreib- und Lese-Cache

Was tun, wenn der ZFS Pool zu langsam ist?

Das kommt entscheidend auf die Konfiguration des Pools an. In unserem Beispiel

besteht der ZFS Pool aus drehenden SATA Platten. Also eine nicht so ideale Konfiguration für ZFS. Für ein produktives System wäre

sicherlich der Austausch der drehenden Platten gegen SSD oder NVMe eine sinnvolle und gute Idee. Wenn es aber um Kosten geht oder

einfach nur ein Test-System ausgestattet werden soll, dann gibt es auch noch andere Möglichkeiten.

Der erste Faktor ist der Lese-Cache, hierfür nutzt ZFS im Proxmox einen Teil des RAM, dies wird als ARC bezeichnet. Und damit fügt ZFS einen sehr performanten

Speicher als Read Cache hinzu. Also könnte ein erster Faktor die Erhöhung des RAM sein. Aber vorher schauen, ob der RAM Cache wirklich

ausgelastet ist. Ist die Erweiterung des RAM nicht möglich, dann kann ein L2ARC (Level 2 ARC) auf einer SSD als Erweiterung dienen, der ist aber langsamer als der RAM.

Eine zweite Möglichkeit ist ein Write Cache. Dies ist eigentlich der Log der Transaktionen des ZFS. Der Write Cache wird deswegen als Log (genauer ZIL) bezeichnet. Der

liegt auf den Platten des Pools, in unserem Beispiel sind dies ja drehende langsame Platten. Packen wir das Log auf SSDs, dann muss es ja schneller werden. Wichtig aber, das sollte

ein Mirror sein, da ein Verlust des Logs zu Datenverlust führt.

ZFS Performance Tuning mit Cache-SSD im Proxmox Server

Befehle aus dem Video:

fdisk /dev/sd(x)

p für Anzeige

n für neue Partition

w für Schreiben der Konfig

zpool add (poolname) log mirror (device1) (device2)

zpool add (poolname) cache (device)

zpool list -v (poolname)

ZFS Filesystem im Proxmox erstellen

ZFS Filesystem erstellen, ist der Pool nicht schon ein Filesystem?

Ja, es kann als Filesystem genutzt werden, es hat im Proxmox sogar einen Mountpoint. Aber ...

In diesem Pool liegt ja normalerweise die Platten der virtuellen Maschinen und Container. Dafür sind sie ja auch gedacht. Und der

Pool an sich kann auch erst einmal nur für VM und Container genutzt werden. Aber warum denn jetzt ein "Verzeichnis" anlegen?

Für das neue Objekt in unserem ZFS Pool kann zum Beispiel eine Quota angelegt werden. Damit kann man das Überfüllen des

Pools verhindern. Und das Ganze ist natürlich auch deutlich besser strukturiert und sicherer im Betrieb.

Wofür kann ich denn jetzt dieses Filesystem nutzen? In Proxmox kann man dort zum Beispiel Sicherungen (also Backups) speichern, oder Images

von Install-Quellen. Oder einfach große Dateien die man für einen Import benötigt oder die aus einem Export kommen. Also schnell mal

temporär was zwischenspeichern.

Wofür sollte man es nicht nutzen? Wenn schon die VMs und Container auf diesem ZFS Pool liegen, dann sollte man nicht die normalen Datensicherungen

auch auf diesen Pool speichern. Wenn jetzt der Pool defekt ist (z.B. Ausfall von mehreren Platten), dann sind sowohl die aktiven Daten (VM und Container) wie auch

die Sicherungen verloren. Also ein kompletter Datenverlust, wenn die Backups nicht noch woanders gespeichert wurden.

ZFS Filesystem für z.B. Backups im Proxmox Server

Befehle aus dem Video:

zfs list

zfs create poolname/filesystemname

Proxmox VE und SDN (Software-Defined Networking)

Mit dem PVE ist seit der 8er Version das Software-Defined Networking möglich. Was ist das? Es können Netzwerke rein

mit der GUI des PVE erstellt werden. Na ja, bei Verbindungen zwischen den Nodes werden auch Netzwerkkarten und physikalische Switche

benötigt. Wenn diese Hardware-Basis erstellt ist, dann kann die Software darauf die Netzwerke definieren.

Welche Möglichkeiten gibt es beim Proxmox VE?

1. Simple Zone:

Ein isoliertes Netz, beschränkt auf den Node des Clusters, es ist DHCP und SNAT möglich.

2. VLAN Zone:

Ein Netzwerk mit VLAN Tagging, welches die Linux oder OVS Bridges nutzt. Die Nodes können hierdurch verbunden werden, wichtig ist die VLAN

Fähigkeit der Bridges und der Switches dazwischen.

3. QinQ Zone:

Ähnlich wie die VLAN Zone, jedoch nutzt QinQ ein VLAN Stacking. Der Datenverkehr wird erst in einem Service VLAN verpackt und dort baut

das SDN dann noch weitere VLANs ein. Wichtig hierbei: Die Switches müssen VLAN Stacking unterstützen.

4. VXLAN Zone:

Das VXLAN baut einen Tunnel auf einem vorhandenen Netzwerk auf. Die Nutzdaten aus Layer 2 werden in Layer 4 UDP Pakete verpackt.

5. EVPN Zone:

Dieses Verfahren baut einen VPN Tunnel mit BGP als Routing Protokoll auf. Damit können verschiedene Cluster verbunden werden.

6. OpenFabric:

OpenFabric ist ein Routing Protokoll speziell für Rechenzentren. Es basiert auf IS-IS (Intermediate System to Intermediate System Protocol, ein Link-State

Interior Gateway Protocol ähnlich OSPF) und ist auf Spine-Leaf-Topologien (Spine-Layer besteht aus Switches, die das Routing übernehmen und als Backbone des Netzes fungieren) optimiert.

7. OSPF

OSPF (Open Shortest Path First) ist ein weit verbreitetes Routing Protokoll, welches auf die kürzeste Verbindung optimiert.

Proxmox VE SDN als Simple Zone

Hinweise zum Video:

Bei älteren Version vom PVE (vor 8.1) müssen einige Komponenten nachinstalliert werden:

apt update

apt install libpve-network-perl

apt install dnsmasq

systemctl disable --now dnsmasq

apt install frr-pythontools

systemctl enable frr.service

Proxmox VE SDN als VLAN Zone

Proxmox VE und OpenFabric für ZFS Replikation und Online Migration

Proxmox VE OpenFabric für ZFS Replikation und Online Migration

Proxmox VE und OpenFabric für das Cluster Netzwerk (Gefahr!)

Proxmox VE OpenFabric für das Cluster Netzwerk (Gefahr!)

Virtuelle Maschinen im Proxmox Cluster

Auf dem Proxmox Cluster können virtuelle Maschinen neu erstellt oder von anderen Umgebungen migriert werden. Mögliche Beispiele stellen wir in Videos vor.

- Linux Server als virtuelle Maschine neu erstellen

- Windows Server als virtuelle Maschine neu erstellen

- Bestehende virtuelle Maschine von VMware migrieren

- Bestehende virtuelle Maschine von Hyper-V migrieren

Linux Debian Trixie als virtuelle Maschine neu erstellen

Windows Server 2022 als virtuelle Maschine neu erstellen - neues Video 2025

Hinweise zum Video:

Download der Treiber für die VM:

https://fedorapeople.org/groups/virt/virtio-win/direct-downloads/archive-virtio/

Importieren einer VMware VM in Proxmox

Hinweise zum Video:

Download der Treiber für die VM:

https://fedorapeople.org/groups/virt/virtio-win/direct-downloads/archive-virtio/

Download OVF Tools: https://developer.vmware.com/web/tool/4.6.0/ovf-tool/

Befehle:

1. ovf-Tool herunterladen und entpacken (wget und unzip)

2. in das Verzeichnis wechseln

1. ./ovftool vi://root@esx-server/import-vm /import/

2. qm importovf id-nr /import/import-vm/import-vm.ovf storage

Update zum Import einer VMware VM in Proxmox

Hinweise zum Video:

Download der Treiber für die VM:

https://fedorapeople.org/groups/virt/virtio-win/direct-downloads/archive-virtio/

Die OVF Tools von VMware (das ist Open Source) sind in der Proxmox VE 8.2.2 schon integriert. Dies ermöglicht den einfachen Import einer virtuellen Maschine.

Docker-Engine auf Proxmox VE - Installation auf Debian Trixie als VM

Weitere Informationen und die passenden Befehle für Copy&Paste finden Sie bei den Informationen zu Docker. Neben diesem Video auch weitere Grundlagen zu Docker, sowie Anleitungen zu Portainer, einer Verwaltung für Docker Container.

Windows 10 auf 11 Migration als Proxmox VM

Eine vorhandene Windows 10 VM soll auf Windows 11 migriert werden. Jedoch meldet die PC-Integritätsprüfung unter Windows 10 noch einige Fehler, die eine Migration verhindern:

- Boot Platte (Laufwerk c:) zu klein

- Boot Platte auf MBR

- kein UEFI Boot

- kein TPM 2.0

- veralteter nicht unterstützter Prozessor für Windows 11

Windows 11 Migration als Proxmox VM Teil 1: Problembeseitigung

Auflistung der Befehle für die Anpassung:

reagentc /disable

diskpart

list disk

select disk <recovery partition>

list partition

select partition <recovery partition>

delete partition override

quit

diskpart

list disk

select disk <recovery partition>

list partition

select partition <recovery partition>

set id=27

quit

reagentc /enable

mbr2gpt /validate /disk:0 /allowfullos

mbr2gpt /convert /disk:0 /allowfullos

Hinweis:

Falls nach dem Erstellen der TPM-Disk kein Snapshot unter Proxmox mehr möglich ist, dann liegt die TPM Platte (die ist zur Zeit immer raw)

auf einem Storage, das keine SnapShots ohne qcow2 Format unterstützt (z.B. LVM, Directory, NFS, CIFS). Bei ZFS oder Ceph sollte es keine Probleme geben.

Was kann man in diesem Fall tun? Ohne TPM Disk läuft Windows 11 nicht. Der Tipp mit dem Löschen der TPM Disk nach erfolgreicher Installation ist wahrscheinlich

nicht so gut, wir konnten auf jeden Fall Probleme im Betrieb feststellen. Und die TPM Disk ist zur Zeit immer im raw-Format, da kann man auch nichts ändern. Also

muss die TPM Disk auf ZFS oder Ceph, dann gehen Snapshots wieder. Oder man verzichtet auf die SnapShots und nutzt zur Datensicherung den Proxmox PBS.

Windows 11 Migration als Proxmox VM Teil 2: Upgrade von 10 auf 11

Link für den Installations-Assistenten:

https://www.microsoft.com/de-de/software-download/windows11

Falls der Fehler 0x8007007f auftritt:

1. Virenscanner deaktivieren

2. veraltete Treiber spez. die virtio Treiber aktualisieren

3. sfc /scannow (Suche nach fehlerhaften Systemdateien)

4. das Upgrade als Administrator ausführen

Proxmox VE - Docker Container nativ auf PVE

Mit der Version 9.1.1 kann auf einem Proxmox VE direkt ein Docker Container ausgeführt werden. Dieses neue Feature ist noch in der Beta Phase, aber man sieht schon die Funktion und auch die Integration in die GUI. Viele Anpassungen des Containers müssen noch in der CLI durchgeführt werden, aber ein erster Betrieb von einfachen Containern ist direkt mit der GUI möglich.

Docker Container nativ auf Proxmox VE ab 9.1.1

Docker auf Proxmox vs. LXC auf Proxmox

Docker auf Proxmox seit PVE 9.1 und dann auch noch Docker auf einer VM mit Docker Engine und auch noch der LXC

auf Proxmox? Was denn noch alles?

Das nachfolgende Video, bzw. die beiden Videos, sollen etwas Licht ins Dunkle bringen. Was kann wofür eingesetzt werden und wo liegen

die Vor- und Nachteile der einzelnen Lösungen.

Teil 1 zeigt Docker auf Proxmox am Beispiel von Wordpress. Wie kann ein Docker Container direkt installiert werden, ja es ist kein richtiger

Docker Container, sondern ein OCI Container. Welche Probleme können auftreten und wie kann man dabei Fehler suchen und beheben. Das alles zeigt das erste

Video und macht auch eine ganz klare Aussage.

Docker auf Proxmox Im Vergleich zu LXC - Teil 1

Das Fazit aus Video 1:

1. Docker (OCI) ist noch nicht so richtig gut integriert (aber kann ja noch werden)

2. Fehlersuche ist in der Umgebung nicht so einfach, also Fehler sind nicht so einfach zu finden

3. Vieles ist noch undokumentiert, aber auch das kann ja noch werden

4. Für kleine Anwendungen ohne viele Daten ist Docker (OCI) jetzt schon nutzbar

5. Es gibt deutlich mehr fertige Docker Container als LXC Container

LXC auf Proxmox Im Vergleich zu Docker - Teil 2

Das Fazit aus Video 2:

1. Alles ist in einem Container fertig vorbereitet

2. https für die Webseite sofort verfügbar inkl. Zertifikatsverwaltung

3. Administrationstools vorhanden für Datenbank, Webserver, Mail, ...

4. MTA enthalten

5. Frage: Ist das alles sicher und wird es auch mit Updates versorgt?

Proxmox VE - Betrieb im Unternehmen

Was ist beim professionellen Betrieb einer Proxmox Umgebung zu beachten? Hardware und Installation muss entsprechend durchgeführt und

die Redundanzen müssen vorhanden sein. Wichtig ist dann die kontinuierliche Überwachung der Systeme. Sollte ein Node ausfallen, oder ein

LAN Switch oder auch nur ein Speichersystem volllaufen, alles dies muss sofort erkannt werden. Das ist aber bei jeder Umgebung, egal

ob Virtualisierung und Storage, wichtig und entscheidend für die Zuverlässigkeit.

Wenn man etwas passieren sollte, dann ist der Support wichtig. Einmal für die Hardware und zum anderen auch für die Software, also Proxmox VE und

Proxmox Backup (wenn dies zusammen eingestzt wird).

Und eines hilft meistens: Keep it simple! Es muss übersichtlich, aber trotzdem dokumentiert sein. Die Abläuft müssen klar und strukturiert und am besten

einheitlich sein. Nichts führt schneller zum Übersehen von Fehlern, wenn zum Beispiel jede VM anders ist und jede Sicherung zu einem anderen Zeitpunkt und

in einem anderen Ablauf durchgeführt wird.

Gerade mit weniger Erfahrung in Linux sollte man sich an die Standards von Proxmox halten. Klar, ZFS kann mit vielen Funktionen erweitert werden, es kann ein Caching

aktiviert, komplexe Replikationen und Clones erstellt werden, also automatisch. Aber wenn man es nicht durchschaut und später Fehler nicht findet, dann lieber

an Standards halten. Hilft dann auch beim Support-Fall.

Proxmox - Datensicherung und Restore

- Wenn man es einfach haben möchten, den Proxmox Backup Server verwenden.

- ZFS bietet sich mit SnapShots und Replikationen in kleinen Umgebungen an.

- Backups testen!

Also eigentlich nichts besonderes im Vergleich zu anderen Herstellern. Der Vorteil bei Proxmox: Das Backup gibt es vom gleichen Hersteller mit der gleichen Oberfläche und einer nahtlosen Integration.

Proxmox Backup Server PBS Grundlagen

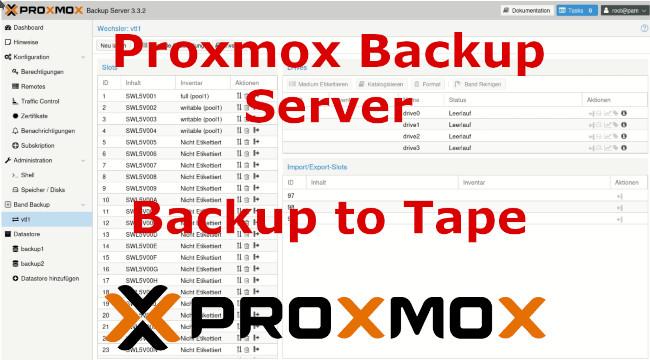

Proxmox Datensicherung auf Tape. Das ist mit dem Proxmox PBS kein Problem. Ein Einzellaufwerk oder eine Library mit LTO Laufwerken am PBS anschließen (egal ob per SAS, Fibre Channel oder iSCSI), den Wechsler einrichten und die Sicherungen starten:

Proxmox Backup Server - Sicherung auf Tape / Bandlaufwerk

Proxmox - Systemsicherung und Restore

Was muss vom eigentlichen System des Proxmox VE gesichert werden? Was kann problemlos restored werden? Und wo muss besonders drauf geachtet werden? Wie ist der Ablauf eines Restores des Systems und wie kann man sich die Arbeit möglichst einfach und sicher machen? Alles das in den beiden Videos. Im ersten Tail die Theorie und im zweiten Teil wird das System gesichert und der Restore erläutert.

Proxmox Systemsicherung - Was muss gesichert werden?

Was muss für eine Sicherung alles konfiguriert werden, wenn die Sicherung auf einen Proxmox Backup Server (PBS) durchgeführt werden soll? Und was ist beim Restore zu beachten? Was darf auf keinen Fall wieder einfach restored werden?

Proxmox Systemsicherung - Sicherung und Restore auf PBS

Skript zur Sicherung:

#!/bin/bash

export PBS_REPOSITORY=sys-pve1@pbs!sys-pve1@10.0.0.70:backup1

export PBS_PASSWORD=caaeeaad-9e16-43dc-ad22-5c34df4ee779

export PBS_FINGERPRINT=71:56:68:fd:73:cf:ec:3b:06:d4:8d:9d:23:83:50:7c:e1:9a:4f:d9:fd:35:5d:27:5f:a0:35:f8:81:fe:cc:2d

proxmox-backup-client backup etc.pxar:/etc/ etcpve.pxar:/etc/pve/ --ns sys-pve1

Erklärung zum Skript:

Unter PBS_REPOSITORY wird die API-Bezeichnung aus dem PBS eingetragen, nach dem @ folgt die IP (oder der Name) des PBS und dann nach dem

Doppelpunkt der Speicher auf dem PBS. Das Password in der nächsten Zeile wird beim Erzeugen des API einmal angezeigt und der Fingerprint ist der

Fingerprint des PBS (aus der Übersichtsseite).

Diese Daten sollten natürlich normalerweise nicht veröffentlicht werden, in diesem Fall ist es aber nur eine Test-Umgebung, die schon wieder gelöscht ist.

Danach folgt der Aufruf des Programms mit dem Parameter backup. Danach folgt die Angabe, was gesichert werden soll, also einmal /etc und einmal /etc/pve. Und das

jeweils in den Namespace sys-pve1. Der Namespace ist quasi das Unterverzeichnis auf dem backup1 Speicher.

Warum muss jetzt /etc und /etc/pve getrennt gesichert werden?

Das Verzeichnis /etc ist im Linux das Verzeichnis für die gesamt Konfiguration des Systems. Normalerweise würde es das Unterverzeichnis pve auch mit einschließen,

beim PVE ist dies aber ein eigenes Filesystem auf einem eigenen Mount-Point. Und die Sicherung greift nicht über mount-points hinweg.

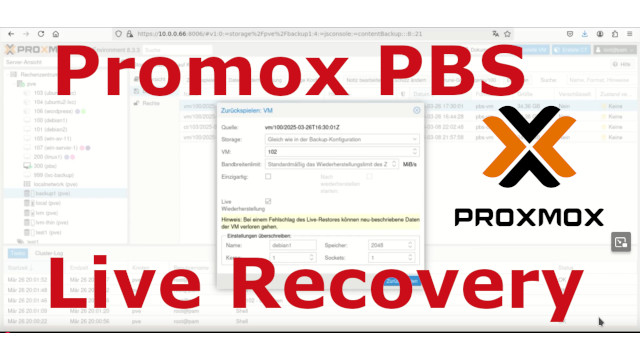

Live Wiederherstellung mit Proxmox PBS

Was ist das Besondere an dem Live Restore von Proxmox?

Die VM kann sofort gestartet werden und der PBS stellt immer genau die Bereiche wieder her, die benötigt werden. Wo bietet dies besondere Vorteile?

Nehmen wir als Beispiel einen großen Fileserver für ein Unternehmen. Einige TB an Daten, viele alte Daten und ein paar sehr wichtige und aktuelle Informationen. Muss

dieser jetzt vollständig nach einem K-Fall restored werden, dann dauert dies sehr lange, im Beispiel einmal 12 Stunden. Ohne die Live Wiederherstellung

müsste man 12 Stunden warten, bis alle Daten vollständig vorhanden sind und erst dann kann man die VM starten und auf die Files zugreifen. Mit der Live Wiederherstellung

kann die VM sehr schnell gestartet werden und nach wenigen Minuten ist der Fileserver einsatzbereit. Alles ist natürlich sehr langsam, da immer erst das wiederherstellt werden muss,

auf das gerade zugegriffen werden soll. Aber man kann und das nach wenigen Minuten. Liegen auf dem Fileserver zum Beispiel die Dokumentation für den weiteren

Ablauf der Wiederherstellung, dann kann dies extrem Zeit sparen. Klar dies Dokument sollte dort nicht liegen, aber ...

Proxmox Backup Server Live Wiederherstellung einer VM

Proxmox - Veeam Backup & Replication

Veeam der Marktführer bei der Datensicherung von virtualisierten Umgebungen bietet jetzt auch eine Möglichkeit zur Sicherung von Proxmox VE an.

Konfiguration von Veeam Backup & Replication für Proxmox VE

Bei der Auswahl des Storage im Proxmox VE ist besonders zu beachten, das es einen Storage mit SnapShot gibt, sonst läuft die Sicherung

über Veeam nicht. Warum denn das? Veeam benötigt für die Worker VM, die auf jedem Proxmox VE Knoten installiert sein muss, einen Speicher mit

SnapShot-Fähigkeit. Also der Speicher mit den eigentlichen produktiven VMs (also die gesichert werden sollen) muss nicht unbedingt SnapShots können.

Wann tritt dieses Problem auf? Ein Bespiel für einen Speichertyp ohne SnapShots ist NFS und LVM. NFS, klar habe ich meinen Speicher auf einem NAS,

dann könnte ich NFS nutzen. Eine sehr einfache Lösung für einen Shared Storage, aber nicht so schnell wie andere Lösungen. Und der LVM wird immer

dann genutzt, wenn über Fibre Channel ider iSCSI Shared Storage angebunden wird. Also im typischen bei einer Migration von VMware zu Proxmox, bei der die

Hardware erhalten bleiben soll. Und da ist ja auch häufig Veeam im Einsatz und soll weiter genutzt werden.

Aber es gibt eine Lösung, die auch nicht viel Geld kostet und evtl. schon im Server vorhanden ist.

Veeam Backup & Replication für Proxmox VE ohne Snapshot - eine Lösung

Veeam kann (Stand März 2025) keine LXC Container in Proxmox direkt sichern. Hierfür zeigen wir in dem folgenden Video ein Umgehung, indem die Container vorab in eine VM gesichert werden. Diese VM kann dann direkt von Veeam gesichert werden. Nicht die eleganteste Lösung, aber wenn nur wenige Container zu sichern sind, ein meist gangbarer Weg.

Veeam Backup & Replication für Proxmox VE Sicherung von LXC - ein Lösungsvorschlag

Proxmox VE Monitoring mit Checkmk

Checkmk überwacht einen Proxmox VE Server direkt mit dem Linux Agent. Die Installation erfolgt wie unter jedem anderen Debian System. Die Standard-Monitoring-Werte sind bei dem PVE vorhanden, sie können aber durch eigene Skript erweitert werden. So können spezielle Zustände von VMs überwacht werden, wie zum Beispiel die Anzahl der Sicherung oder Snapshots. Neben dem Agent ist auch noch eine API für Proxmox VE verfügbar. Hiermit können weitere Werte für die VMs überwacht werden.

Überwachung von Proxmox VE Server über Linux Agent und API

Das Vorgehen für die Installation des Agents ist identisch mit einem normalen Linux Agent:

1. Den passenden Link in der Weboberfläche bei Setup, Agents und Linux kopieren

2. Auf dem PVE in der CLI mit wget das File herunterladen

3. Das File mit apt install ./Filename installieren

4. Absichern des Agents mit cmk-agent-ctl register ... (Checkmk Agent absichern)

Zusätzlich sollte die API genutzt werden.

Hinweis: Nur die neusten Checkmk Versionen bieten zusätzlich Daten für die VMs (z.B. der Backup-Status) durch die API.

Weitere Informationen und Tipps und Tricks zu Checkmk RAW

Proxmox - Security / Schutz vor Hackern

In der Basis-Installation ist nur ein User vorhanden, der "root" für die Weboberfläche und SSH bzw. Console. Ein User der alles darf, aber auch alles zerstören kann. Ein idealer Zustand für den Hacker, eine Katastrophe für den Admin. Also was können wir tun?

- Den root-User so weit wie möglich in der Nutzung begrenzen, also nur für den Notfall

- Komplexe und individuelle Passwörter für die User

- User mit speziellen beschränkten Rechten definieren für die alltägliche Nutzung

- Zweifaktor Authentifizierung nutzen

- Netzwerk segmentieren, kein Zugriff aus dem Internet erlauben

Proxmox Security im Basis-System

Im zweiten Teil folgt die Absicherung der Datensicherung, des Backups. Auch hier sollten nur User verwendet werden, die eine möglichst geringe Berechtigung auf dem Proxmox Backup-Server besitzen. Im Idealfall darf der User auf der Virtualisierung keine Backups löschen dürfen.

Proxmox Security bei der Datensicherung

Wie lässt sich jetzt auf dem Backup-Server das Pruning (also das Löschen der alten Sicherungen) individuell steuern?

Durch ein einfaches Skript auf dem Backup-Server. Dieses überprüft die Anzahl der entsprechenden Sicherungen pro VM und

Löscht im Falle eines Falles dann die passenden alten Sicherungen:

AUS="/tmp/prune.log"

AUS2="/tmp/prune877"

echo "Prune fuer VM100:" >> $AUS

proxmox-backup-client prune vm/100 --keep-daily 7 --keep-hourly 8 --keep-monthly 6 --keep-yearly 4 > $AUS2

cat $AUS2 | grep keep | wc -l >> $AUS

cat $AUS2 | grep remove >> $AUS

Achtung: Dieses Skript löscht wirklich die Sicherung der VM100!!!

Dieses Skript löscht alle Sicherung älter als 7 tägliche, 8 stündliche, 6 monatliche und 4 jährliche Versionen. Es wird z.B. als CRON-Job

einmal pro Tag auf dem Backup-Server gestartet. Es folgt die Ausgabe der Anzahl der vorgehaltenen und der gelöschten Sicherungen. Diese Ausgabe

kann z.B. per Mail an den Administrator geschickt werden.

Werden keine individuellen Aufbewahrungszeiten benötigt, kann der Prune-Job einfach

über die Weboberfläche des Backup-Servern genutzt werden.

Proxmox - ZFS Boot reparieren

Der Proxmox Server bootet von einem ZFS Spiegel und jetzt ist eine Platte ausgefallen? Das lässt sich einfach wieder reparieren. Wichtig ist beim Austausch der Platte, auch wirklich die funktionsfähige Platte im System zu lassen. Im Falle eines Falles bootet das System auch nur von einer Boot-Platte. Was ja genau der Sinn eines RAID 1 als Boot-Platte ist ...

Proxmox Server mit ZFS Boot reparieren

Die folgenden Befehle können in diesem Fall hilfreich sein. Wichtig auf jeden Fall eine Sicherung und bei kleinsten Zweifeln

auf den Hilfeseite von Proxmox schauen:

sgdisk /dev/sda -R /dev/sdd (Quelle = sda Ziel = sdd)

sgdisk --randomize-guids /dev/sdd (Ziel = sdd)

proxmox-boot-tool format /dev/sdd2 (Ziel = sdd2, Achtung der formatiert wirklich!)

efibootmgr -v (wenn EFI not supported, dann grub)

proxmox-boot-tool init /dev/sdd2 grub (Ziel = sdd2 mit grub)

proxmox-boot-tool status

ls -lah /dev/disk/by-id

zpool attach rpool alte-part3 neue-part3 (neue und alte aus dem disk by-id)

zpool status rpool

Achtung: Bei Secure Boot weitere Infos

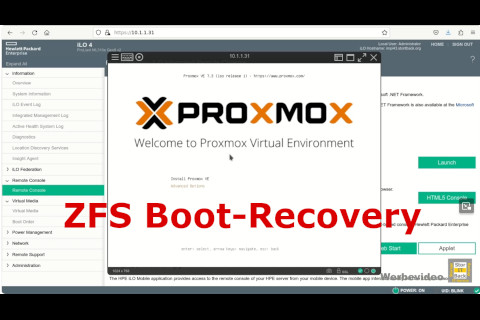

Proxmox - ZFS Boot Recovery

Der Proxmox Server bootet von einem ZFS Laufwerk? Und beim letzten Update ist etwas falsch gelaufen? Oder die letzte Änderung am

System war nicht so gut? Dienste starten nicht mehr oder VMs sind plötzlich sehr langsam oder nicht mehr lauffähig? Also an der Hardware ist

alles in Ordnung, aber die letzte Änderung war wohl nicht so gut ...

Wenn man VORHER einen SnapShot der ZFS Boot-Platten gemacht hat, dann lassen sich die letzten Änderungen sehr einfach wieder zurück rollen. Wichtig dabei,

die Anleitung klappt nur, wenn auch von einem ZFS gebootet wird.

Hinweis:

Dies sollte die letzte Rettung für ein nicht mehr lauffähiges System sein. Es besteht die Möglichkeit, dass das System nach der Recovery nicht mehr stabil oder

nicht mehr bootfähig ist. Daher sollte IMMER auf ein aktuelles Backup geachtet werden. Dies schließt nicht nur die virtuellen Maschinen und Container ein,

sondern auch die Boot-Platten bzw. die Konfiguration. Ist die Konfiguration gesichert und alle Anpassungen wurden dokumentiert, dann ist immer noch

eine Neuinstallation möglich, falls die Recovery fehlschlägt.

Proxmox Server nach Updates mit ZFS recovern

Die folgenden Befehle können in diesem Fall hilfreich sein. Wichtig auf jeden Fall eine Sicherung und bei kleinsten Zweifeln

auf den Hilfeseite von Proxmox schauen:

zfs snapshot -r root@vers7 (vor jeder größeren Änderung)

Boot von der Installations-CD (oder Installations-USB-Stick)

in "Installation mit Debug" wechseln

in der Commandline (evtl. erst die zweite CLI) dann folgende Befehle:

zpool import -f rpool

zpool list (rpool muss vorhanden sein)

zfs list -t snapshot (die SnapShots vor der Änderung müssen vorhanden sein)

zfs roolback -r rpool@vers7

zfs roolback -r rpool/ROOT@vers7

zfs roolback -r rpool/ROOT/pve-1@vers7

zfs roolback -r rpool/data@vers7

Anpassung auf den jeweiligen Namen des SnapShots und evtl. der ZFS-Verzeichnisse

zpool export rpool

Reboot

Achtung: Beim ersten Reboot im grub oder UEFI die richtigen Kernel auswählen, wenn dort eine Änderung passiert ist!

Soll weiterhin der alte Kernel gebootet werden, dann in /etc/default/grub anpassen und update-grub nicht vergessen

Erklärungen und Erläuterungen

1. ZFS

ZFS ist ein von Sun Microsystems entwickeltes transaktionales Dateisystem, das zahlreiche Erweiterungen für die Verwendung im Server- und

Rechenzentrumsbereich enthält. Hierzu zählen die vergleichsweise große maximale Dateisystemgröße, eine einfache Verwaltung selbst

komplexer Konfigurationen, die integrierten RAID-Funktionalitäten, das Volume-Management sowie der prüfsummenbasierte Schutz vor Datenübertragungsfehlern.

2. Ceph

Ceph ist eine quelloffene verteilte Speicherlösung. Kernkomponente ist mit RADOS (Reliable Autonomic Distributed Object Store) ein über beliebig

viele Server redundant verteilbarer Objektspeicher. Ceph bietet dem Nutzer drei Arten von Storage an:

Einen mit der Swift- und S3-API kompatiblen Objektspeicher (RADOS Gateway)

virtuelle Blockgeräte (RADOS Block Devices)

CephFS, ein verteiltes Dateisystem.

Ceph kann als RADOS Block Device (RBD) über das Ceph iSCSI Gateway auch als hochverfügbares iSCSI-Target bereitgestellt werden.

Dadurch kann es auf Client-Seite durch viele Betriebssysteme (auch Windows) genutzt werden. Die Entwicklung startete im Jahr 2012 und Ceph ist die Basis

für viele Cloud-Architekturen.

3. Corosync

Die Corosync Cluster Engine ist ein quelloffenes und verteiltes System für das Management von HA-Computerclustern, basierend auf dem Betriebssystem Linux.

Die Software steht unter der freien BSD-Lizenz und ist in der Programmiersprache C geschrieben. Dies ist die Basis für den Proxmox VE Cluster.

4. Shared Storage im PVE

Der Shared Storage kann über iSCSI oder Fibre Channel angebunden werden. Die Besonderheit ist dabei, dass die Daten auf allen Knoten immer

gleich sind. Sie liegen ja zentral auf dem Shared Storage. Damit ist ein Failover ohne Datenberlust möglich, genauso wie bei Ceph.

5. SDN (Software Defined Networking)

Es wird ein einheitliches Netzwerk zwischen bzw. über die Cluster Nodes eines Proxmox VE Clusters aufgebaut. Es sind verschiedene Funktionen möglich,

von einer Simple Zone (ein isoliertes Netz) bis zu Open Fabric und OSPF.

6. LXC (Linux Container)

Eine Variante, um virtuelle Systeme zu definieren. Bei einem Linux Container nutzen die LXC Systeme den Kernel des Hosts mit, also ähnlich wie die Docker

Container. Ein LXC "sieht" aber intern eher wie eine virtuelle Maschine aus, nur einige Kernel-based Funktionen sind nicht verfügbar. Ein LXC ist also

nicht für jede Anwendung nutzbar. Aber extrem sparsam bei CPU, RAM und Plattenplatz.

7. Live Restore beim Proxmox Backup Server

In dieser Variante wird die zu restorende Maschine sofort gestartet und es es immer genau das zurückgespielt, was zum Starten bzw. Ausführen benötigt wird. Damit

ist die virtuelle Maschine sehr schnell wieder nutzbar. Allerdings wenn Daten benötigt werden, die noch nicht zurückgeschrieben wurden, dann muss

man etwas warten. Ideal für große Fileserver, wichtige Daten sind schnell zugreifbar.

8. ZFS ARC / L2ARC

Der Begriff ARC beschreibt den Adaptive Replacement Cache, den Read Cache vom ZFS im RAM. Der L2ARC liegt aber nicht im RAM, sondern erweitert den ARC auf SSD oder NVMe, also

der Level 2 ARC. Am schnellsten ist der RAM, dann kommen NVMe und danach SSD. Für maximale Performance sollte man also den RAM nutzen und nur, wenn dieser nicht

erweiterbar ist, auf NVMe oder SSD zurückgreifen.

9. ZFS ZIL

Der ZIL ist das Transaktions-Log des ZFS, also das ZFS Intend Log. Es wird häufig auch als Schreib-Cache bezeichnet. Na ja, die Schreib-Operationen landen im ZIL

und werden regelmäßig auf die Platten im Pool geschrieben. Also kann man es als Schreib-Cache bezeichnen. Der ZIL liegt (wenn nicht konfiguriert) mit auf den Datenplatten, kann aber auf

ein Mirror von NVMe oder SSD ausgelagert werden. Also von langsamen oder stark belasteten Platten auf schnelle und eigene Flash Speicher. Aber wichtig ist der Mirror. Geht das ZIL

verloren, so gehen die letzten Schreib-Daten verloren. Also ein echter Datenverlust im Pool.

Angebote der Stor IT Back zum Thema Proxmox

Proxmox VE Virtualisierung

QEMU/KVM und LXC (Linux Containers)

auf Lenovo Server

Single Server bis HA-Umgebung

ab 4.155,00 Euro

zzgl. MwSt.

Open-E JovianDSS Storage

ZFS-based Appliance, kostengünstig

SSD/SAS/NL-SAS, HA Cluster, Metro-Cluster

Preis

bitte anfragen

Schulungen und Workshops

Storage (SAN, NAS, iSCSI)

Backup (LANfree, SnapShot)

Storage- und Servervirtualisierung

Praxis-Schulungen

individuell / auch Inhouse